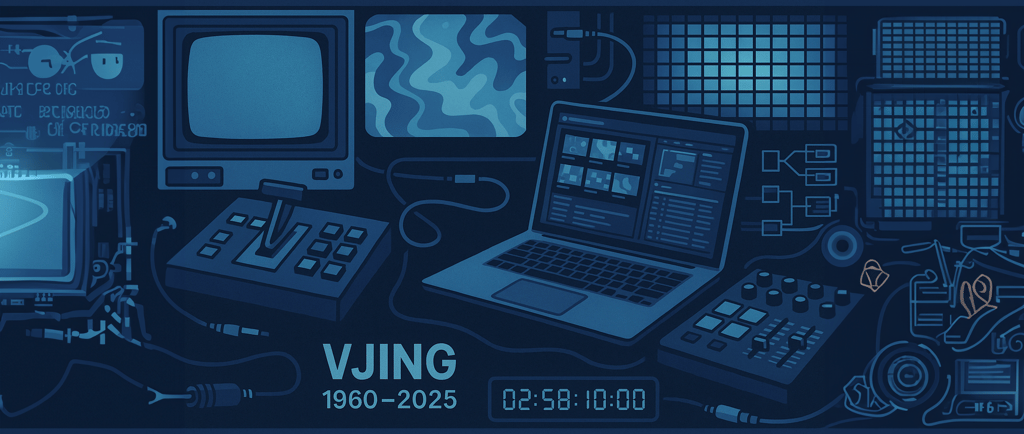

VJ: historia del video jockey — de los inicios al realtime (2025)

VJ: historia del video jockey — de los inicios al realtime (2025)

VJ, video jockey, historia del VJing, visuales en vivo, mapping, media servers, Resolume, TouchDesigner, Notch, realtime.

¿Qué es un VJ hoy?

VJ (video jockey) es quien diseña, mezcla y ejecuta imágenes en vivo sincronizadas con música, palabra o escena. Puede operar desde un booth en un club, una cabina en un festival, o en cabina técnica de un evento corporativo con pantallas LED, proyectores y media servers. El VJ moderno es mitad operador y mitad director de arte en tiempo real.

Línea de tiempo — del cine expandido al tiempo real

1960s–1970s: orígenes analógicos

Cine expandido & videoarte: performances con proyectores de 16 mm, feedback de cámara, imanes sobre CRTs, sintetizadores de video DIY.

Conciertos multimedia: luces, diapositivas y superposiciones sobre bandas; aparecen los primeros mixers rudimentarios.

1980s: clubes, raves y hardware dedicado

Club culture: la música electrónica y los videoclips alimentan cabinas con mezcladoras de video, genlocks y titlers.

Sintetizadores de video comerciales (Fairlight CVI, etc.) permiten keying, solarizaciones, posterizaciones en vivo.

Surge el concepto de VJ como rol autónomo: no sólo “poner videos”, sino componer visuales.

1990s: digital temprano

Captura y edición no lineal: PCs/Macs con tarjetas de video; samplers de video.

NewTek Video Toaster, Panasonic/WJ, mezcladoras con T-bar populares en raves.

Nace el tempo visual: loops, BPM, midi para disparar clips.

2000s: software de VJ y laptops

Irrumpen ArKaos, Resolume (2002), Modul8, VDMX, Quartz Composer.

El VJ arma librerías de loops (DXV/PhotoJPEG), usa MIDI/OSC, captura cámaras en vivo, hace edge blending simple.

Aparece el mapping—warping básico para superficies irregulares y arquitectura.

2010s: media servers y 3D en tiempo real

Estalla el projection mapping y el ecosistema LED.

Se profesionaliza con Watchout, disguise (d3), Hippotizer, Resolume Arena; control timecode/SMPTE y show control.

Entra el realtime con TouchDesigner, Notch, Unity/Unreal. VJ = operador + técnico de sistemas + diseñador.

2020s–2025: XR, generativo y data-driven

Pantallas masivas de alta frecuencia, NDI/SDI de baja latencia, workflows HDR selectivos.

Visuales generativos (GPU), sensores (Kinect/IMU/visión por compu), data-viz en vivo, y herramientas con IA para look-dev.

El VJ se integra al pipeline de eventos: preproducción, contenidos, sincronía con luces, redundancia y broadcast/stream.

Técnicas clave que definieron la práctica

Beatmatching visual: loops ajustados a BPM, envelopes y LFOs.

Keying y blending: chroma/luma, mezcla sobre cámaras o feeds corporativos.

Mapping: warping, UV, perspectiva; de superficies simples al 3D/anamórfico en LED.

Show control: MIDI/OSC/Art-Net/sACN, timecode para cues precisos.

Generativo: partículas, campos de fuerza, shaders; respuesta a audio y sensores.

Operación multicapa: mezclar brand assets, PPT/Keynote limpio, ticker de data y cámaras.

Setups representativos por época (y hoy)

Old school (90s): reproductores DV, mezcladora analógica, T-bar, titler.

2000s: laptop + Resolume/Modul8, controlador MIDI, capturadora.

2010s: media server + Resolume/Watchout, router SDI, timecode, operación dual (main/backup).

2025: servidor RTX, TouchDesigner/Notch/Unreal, integración LED/mapping, sync con audio/luces, redundancia con playback backup.

El VJ en eventos corporativos (tu foco)

Role mix: VJ + operador de media server + coordinador de señales.

Qué resuelve:

Cohesión visual entre marca, speakers y show.

Reacción en vivo (timings, cambios, improvisos).

Integración técnica: LED, proyección, cámaras, streaming, intérpretes, retorno de sala.

Buenas prácticas: safe-areas para logos, contraste alto para salas claras, refresh > 3.840 Hz en LED si habrá prensa.

Mini-glosario VJ (útil para clientes)

Loop: clip de video que se repite sin salto.

Mapping: ajustar la imagen a superficies no planas.

Generativo: imagen creada por código/shaders en tiempo real.

Timecode: reloj que sincroniza luces, audio y video.

Playback: salida de video final hacia el sistema (Switch/Processor).

Cómo empezar hoy (equipo base escalable)

Laptop GPU (RTX/Apple Silicon) con SSD rápido.

Software: Resolume Arena + (opcional) TouchDesigner/Notch para generativo.

Control: MIDI (Akai APC/Launchpad) + OSC desde tablet.

Captura/IO: SDI/HDMI (DeckLink, Magewell).

Señal: router/SDI, conversores, NDI en red confiable.

Contenido: librería propia (DXV/ProRes Proxy) + presets generativos.

Redundancia: segundo player con switch rápido a program.

Preguntas frecuentes

¿Qué diferencia a un VJ de un editor de video?

El VJ crea y decide en vivo: mezcla, reacciona al público y al show, integra señales y resuelve problemas en tiempo real.

¿Sigue existiendo el VJ con pantallas LED?

Sí, y con más peso: operar LED implica gestión de resoluciones, mosaicos, refresh, color y muchas veces 3D/anamorfismo.

¿Qué software conviene para empezar?

Para eventos: Resolume Arena. Si querés visuales generativos o interacción, sumá TouchDesigner o Notch.

¿VJ es sólo para boliches?

No. En corporativo el VJ aporta control en vivo, diseño y solvencia técnica que evita fallas y eleva la experiencia.

Cierre

El VJ evolucionó de mezclar cintas y feedback analógico a dirigir imágenes en tiempo real sobre ecosistemas complejos de LED, proyección y broadcast. La esencia se mantiene: música + imagen + público; lo que cambió es el nivel de integración técnica y artística que hoy exige un evento.